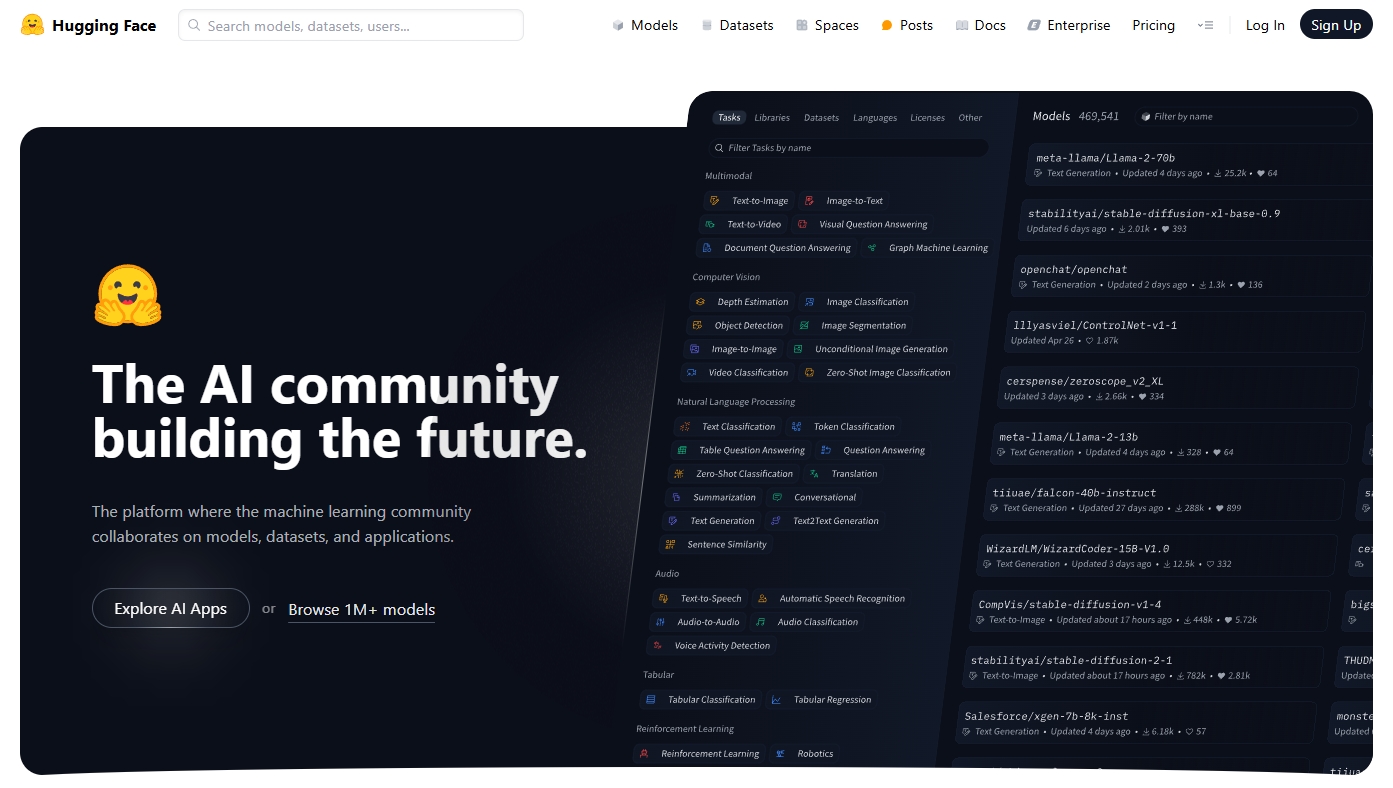

专注于自然语言处理(NLP)和人工智能(AI)。该平台目前托管了超过320,000个模型和50,000个数据集,成为全球机器学习社区合作开发模型、数据集和应用程序的主要集合地。

核心特点:

- 合作平台:Hugging Face是一个合作平台,提供无限模型、数据集和应用程序的托管和协作服务。

- 加速机器学习:通过其开源堆栈,Hugging Face帮助用户加速机器学习项目。

- 多模态探索:支持文本、图像、视频、音频甚至3D内容的机器学习任务。

- 构建个人作品集:用户可以共享自己的工作,构建自己的机器学习作品集。

- 企业级服务:提供企业级安全性、访问控制和专业支持的高级平台,帮助企业构建AI。

- 广泛应用:超过50,000个组织正在使用Hugging Face,其中包括Allen Institute for AI、Meta、Amazon Web Services、Google、Intel、Microsoft等。

- 开源精神:Hugging Face秉承开源精神,与社区一起构建机器学习工具的基础。

核心模块

1. Models(模型)

Hugging Face提供了超过320,000个模型,涵盖了各种不同的任务和需求。这些模型支持ONNX格式,允许跨平台加速,特别是对于云模型和语言模型。目前,大约6,000个模型在Hugging Face模型中心明确表示支持ONNX,但超过130,000个模型实际上支持ONNX格式。

2. Datasets(数据集)

Hugging Face提供了超过50,000个不同的数据集,涵盖了各种类型的机器学习任务。这些数据集可用于训练、测试和验证各种AI模型。

3. Spaces(空间)

Spaces是一个平台,允许用户运行和共享AI应用程序。它提供了超过100,000个应用程序,覆盖了文本、图像、视频、音频甚至3D等多种模态。

4. Transformers库

Transformers库是Hugging Face的重要组成部分,提供了用于PyTorch、TensorFlow和JAX的先进机器学习模型。

5. Diffusers库

Diffusers库专注于图像和音频生成的扩散模型,特别适用于PyTorch。

6. Tokenizers库

Tokenizers库提供了快速的文本分词器,适用于研究和生产环境,优化了各种预训练模型的兼容性。

7. 其他工具和库

包括但不限于Safetensors(简单、安全地存储和分发神经网络权重),Hub Python Library(客户端库,用于管理Python运行时的HF Hub存储库),PEFT(大型模型的参数高效微调方法),以及Transformers.js(在浏览器中运行预训练模型的社区库)。

Hugging Face对普通开发者来说有什么用

- 快速接入最新的NLP技术:Hugging Face的Transformers库提供了大量的最新预训练模型,如BERT、GPT、T5等。这意味着即使是没有深厚机器学习背景的开发者,也能快速接入和利用这些先进的NLP技术。

- 简化模型训练和部署流程:Hugging Face的工具简化了从数据预处理、模型训练到部署的整个流程。它提供了易于使用的接口和丰富的文档,帮助开发者在较短时间内实现复杂的NLP应用。

- 广泛的应用场景:无论是文本分类、问答系统、机器翻译、文本生成还是情感分析等任务,Hugging Face都提供了相应的模型和工具。这使得开发者能够为多种应用快速构建和部署有效的NLP解决方案。

- 社区支持和资源:Hugging Face有一个活跃的社区,开发者可以在这里找到大量的教程、案例和讨论,这对于学习和解决问题非常有帮助。

- 灵活性和可定制性:虽然Hugging Face提供了许多预训练模型,但它也支持定制和扩展。开发者可以根据自己的特定需求调整模型,或者在现有模型的基础上进行进一步的训练。

- 云平台集成:Hugging Face与多个云平台(如Azure和AWS)的集成,使得部署大型模型变得更加容易,特别是对于需要高计算资源的任务。